La voiture autonome c'est pour aujourd'hui ou pour demain ? avec Eloi Zablocki - Valeo.ai

💡 millefeuille.ai: le media pour comprendre les enjeux de l’IA et les mettre à profit dans notre société et nos métiers — par un collectif d’ingénieurs & d’entrepreneurs français.

Hello tout le monde !

On est très contents de te présenter ❤️ Au coeur de l’IA, une conversation avec des experts 🙌

Tu l’as compris l’IA et ses impacts sur la société et nos métiers nous passionnent depuis longtemps. Et depuis quelques mois on discute avec des experts & chercheurs du secteur - qu’ils travaillent chez Deepmind, Meta, HuggingFace, Farmwise, Mistral et Neuralink.

On est aussi aller interroger des entrepreneurs & des salariés qui utilisent les outils dans leur quotidien pour améliorer leur vie.

On s’est dit qu’on allait te partager toutes ces conversations pour aller plus en profondeur sur les sujets et satisfaire ta curiosité - démêler le mythe de la réalité, le vrai du faux.

N’hésite pas à nous donner des feedback - le format et le fond évolueront comme toujours en fonction de ce que tu aimes !

Aujourd’hui on te partage notre conversation avec Eloi Zablocki. Le thème est la voiture autonome !

🎓 Eloi a obtenu sa thèse sur l’apprentissage automatique multi-modal à partir de données textuelles et visuelles 🧐. Pour son travail il a été finaliste du prix de la meilleure thèse francaise en IA en 2020. 💪

🚙 Eloi a alors rejoint Valeo.ai - laboratoire de recherche en IA de Valeo - il y travaille sur des thématiques liées à la vision par ordinateur pour la conduite autonome et assistée. Ses travaux sont publiés dans des conférences & des revues spécialisées - si tu es intéressé(e) par le sujet n’hésite pas à le contacter !

Au menu aujourd’hui :

🍸 le cocktail des défis de la voiture autonome

🚕 la voiture autonome pour aujourd’hui ou pour demain ?

🧪 les innovations à venir pour tous les automobilistes

🔭 les tendances de recherche

👀 où se renseigner - les sources recommandées par Eloi

Eloi : en vrai à gauche, au grand prix de Monaco à droite 🏎 (fait avec midjourney)

Si quelqu’un t’a transféré cette édition et que tu souhaites t’inscrire à millefeuille.ai c’est par ici :

🍰 MillefeuilleAI : Hello Eloi, peux-tu nous dire ce qui t’a séduit dans le secteur de la voiture autonome ?

👉 Eloi :

Ce qui m’a attiré c’est le cocktail de problèmes concrets et variés que l’on trouve dans ce domaine. Imagine par exemple : tu dois faire en sorte que ta voiture prenne en compte un piéton 🚶🏻♂️

d’abord pour le détecter - il faut fusionner plusieurs informations à partir de capteurs (caméras, LiDAR ou RADAR)

il faut aussi comprendre l’intention du piéton - via certains indices comme l’orientation de son regard. 👀

pour estimer ensuite les trajectoires qu’il pourrait emprunter

Côté modèles d’IA pour corser le tout on doit développer des modèles légers (pour être embarqués sur des puces dans la voiture), robustes (en cas de défaillance d’un capteur) et qui généralisent à de nouvelles situations : méteo, si la personne a des vêtements exotiques ou capables de détecter d’éventuels biais.

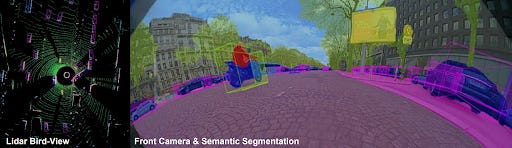

Voilà typiquement des données qu’on manipule - elles proviennent de caméras qui filment à 360, les nuages de points sont acquis à partir d’un LiDAR installé sur le toit de la voiture.

“Ce qui m’a attiré c’est le cocktail de défis concrets & variés”

🍰 MillefeuilleAI : Mettons les pieds dans le plat - la voiture autonome c’est pour quand ?

👉 Eloi :

Tu sais ca fait 10 ans que certains disent que c’est pour l’année prochaine, avec un succès mitigé donc je ne te donnerai pas de date précise 😁.

Pour autant… la voiture autonome est déjà en partie une réalité !

🚕 Dans certaines villes américaines comme San Francisco, Phoenix, Austin il est possible de réserver une course de taxi autonome. Ce n’est qu’une étape :

ces voitures embarquent des capteurs très puissants dont le coût total est de l’ordre de plusieurs centaines de milliers d’euros → ce n’est pas viable pour ta propre voiture

elles roulent dans des zones relativement simples à gérer, c’est à dire : déjà cartographiées, où il ne pleut quasiment jamais, où les routes sont larges et droites.

Le défi est de pouvoir généraliser à de nouveaux environnements, non connus à l’avance plus complexe dans leur structure ou dans le comportements des agents avec des capteurs bons marchés. Ce sont les questions de recherche que nous traitons chez Valeo.ai. 💪

Autrement dit entre les rues du centre d’Austin, Texas et du centre de Paris il y a encore un monde 🌏.

🪄 Il faut quand même avoir en tête qu’on a déjà des voitures “augmentées” avec de l’IA pour le confort ou la sécurité - les systèmes de freinage d’urgence, de détection de fatigue, de parking automatique, de régulateurs de vitesse adaptatifs.

“Le vrai défi, c'est de faire fonctionner ces voitures dans de nouveaux environnements, plus complexes, avec des capteurs plus abordables."

🍰 MillefeuilleAI : À l'image d’OpenAI qui a réussi à marketer de nombreux cas d’usages via ChatGPT, quelles sont les prochaines innovations IA dont vont pouvoir bénéficier les automobilistes ?

👉 Eloi :

Les conditions d'application de conduite autonome qui sont pour l’instant très restreintes vont s'élargir grâce aux avancées de l’IA.

Les interfaces évolueront également pour devenir plus intuitives, notamment grâce au suivi du regard du conducteur. 👀

L’utilisation du langage aura aussi un rôle essentiel dans la communication entre le véhicule et les passagers. 🗣

Et puis l’éclairage va connaître une révolution. Imagine que les ampoules des phares sont maintenant remplacées par des sortes de petits vidéo-projecteurs 🎥 à plusieurs millions de pixels qu’on peut contrôler indépendamment.

L’impact c’est un éclairage optimal de la route. Mais aussi une meilleure mise en évidence des obstacles spécifiques sur la route, ou alors des phares qui s’alignent avec le chemin à suivre et peuvent communiquer des intentions de virage aux autres usagers de la route.

Des algorithmes peuvent même éteindre les rayons lumineux qui rencontrent les gouttes de pluie 🌧 pour réduire l’éblouissement du conducteur et améliorer la visibilité. Ce n’est pas une petite amélioration sachant que la nuit le risque d’accident mortel est multiplié par 7 !

Exemple de phares intelligents qui projettent sur la route une zone de sécurité à respecter pour dépasser le cycliste.

🍰 MillefeuilleAI : Tu as participé le mois dernier à CVPR 2023, la plus grande conférence de vision par ordinateur, quelles sont les tendances ?

👉 Eloi :

C’était intense ! Pendant 3 jours, environ 400 papiers de recherche sont présentés chaque demi-journée 😅.

Sans surprise, les modèles dits de “fondations” (LLM) y occupaient une large place. Ce sont de larges modèles qui voient certaines propriétés émerger quand ils sont entraînés sur de gigantesques bases de données. Avec ce passage à l’échelle, les paradigmes changent. Par exemple, pour faire de la reconnaissance d’objet, il fallait classiquement annoter une base de données pour entraîner un modèle qui sera restreint à ne reconnaître que les classes qu’il a vu pendant l’apprentissage. Maintenant, les modèles de “fondation” entraînés sur du texte et des images permettent de pouvoir généraliser à la fois au-delà des classes d’apprentissage, mais aussi à de nouvelles tâches grâce à quelques exemples seulement.

D’autres sujets étaient aussi très représentés, notamment les modèles “NeRF” (Neural Radiance Field) qui peuvent produire de nouveaux points de vue pour des scènes 3D statiques ou dynamiques depuis des positions de caméra arbitraires, mais aussi les modèles de diffusion pour la génération d’images ou de vidéos, ou encore l’estimation de pose d’objets ou de personnes dans l’espace tridimensionnel, en lien avec des applications AR/VR.

La prochaine a lieu à Paris en octobre 🐓🇫🇷 - ICCV 2023

🍰 MillefeuilleAI : de ton côté qu’est-ce qui te paraît intéressant dans ces directions de recherche ?

👉 Eloi :

Un des challenges en vision est que certaines situations sont extrêmement rares mais pourtant essentielles. Typiquement, des objets peuvent tomber sur la route (chute de pierres, de branches, de chargement d’un autre véhicule). On peut croiser un animal sur la route !

Ce n'est pas envisageable d’anticiper toutes ces situations de manière exhaustive, en les listant, et en collectant des données d’apprentissage pour chacune. L’utilisation des modèles de fondation me semble clé pour raisonner sur ces cas rares, notamment grâce à leur capacité de généralisation.

Pour autant, ces modèles manquent encore de bon sens. Ils vont requérir d’être plus ancré dans le monde réel pour améliorer leur raisonnement. Par exemple via des images ou des vidéos.

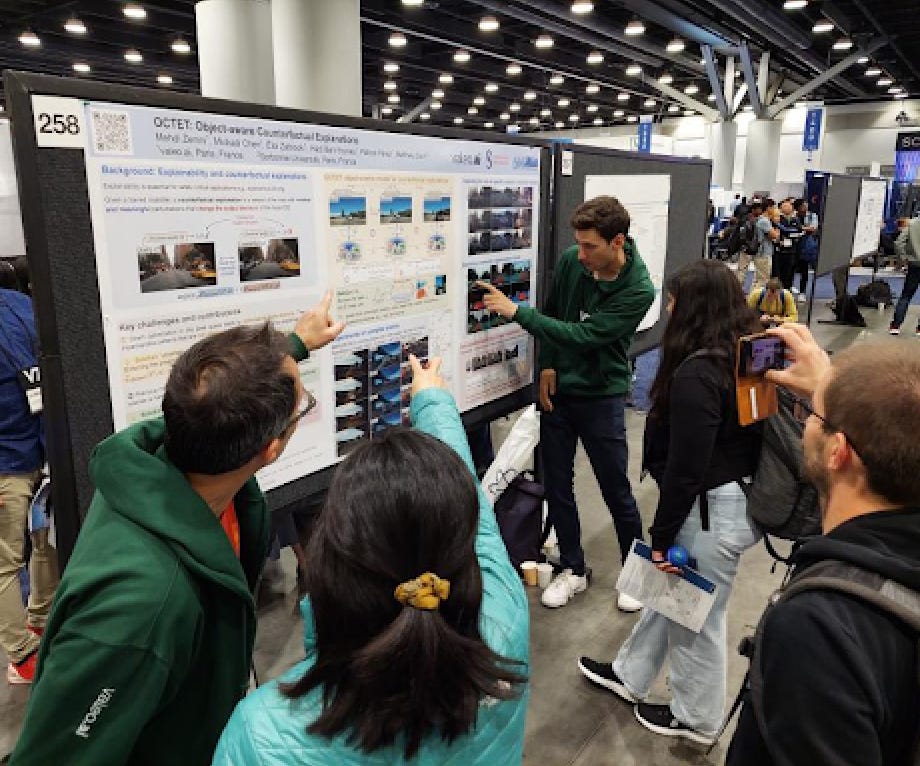

Exemple d’une méthode d’explication pour les voitures autonomes, qu’on développe chez Valeo. Ici, l’IA génère des explications “contrefactuelles” qui sont des situations proches de la réalité mais où des décisions différentes seraient prises. Cela permet de vérifier que les décisions sont prises pour des raisons logiques.

🍰 MillefeuilleAI : merci Eloi ! Est-ce que tu peux nous laisser les sources que tu recommandes si on veut aller plus loin sur le sujet ?

👉 Eloi :

💻 un blog - celui de Tristan Rice. Il a hacké sa Tesla pour tester ses propres algorithmes DIY de conduite autonome 😱

🎓 un chercheur - Andreas Geiger qui dirige le groupe de vision autonome à l’université de Tübingen. Sa chaîne youtube est excellente. 👍

📄 un papier de recherche - UniSim: A Neural Closed-Loop Sensor Simulator de Yang et al. CVPR 2023. Ce papier introduit une méthode pour rejouer une scène réelle et étudier le comportement d’une voiture autonome si les autres agents avaient pris d’autres décisions. Les vidéos de démonstration sur le site sont impressionnantes.

Très belle semaine à tous !

— l’équipe millefeuille.ai

Si tu as aimé l’édition, pense à cliquer sur le bouton ❤️ et à laisser un commentaire pour que plus de personnes puissent découvrir millefeuille.ai sur Substack 🙏.

👉 Et c’est par ici pour nous suivre sur Linkedin et Twitter 👈